Salut !

Je n'ai absolument pas tout lu, mais il manque à mon avis dans l'introduction une brève explication de ce qu'est un arbre de décision. Pour l'instant, on est directement projeté dans le machine learning, sans comprendre le rapport avec le titre du tutoriel. Je te conseille donc de donner une définition intuitive et peu rigoureuse des arbres de décision ainsi que des exemples d'utilisation puis de préciser tout ça en introduisant des notions plus avancées. Actuellement, il faut passer par le long paragraphe sur l'apprentissage automatique avant de croiser les arbres de décision. En fait, tu prends le problème à l'envers, je pense. Tu pars d'une définition théorique des arbres de décision, puis tu l'expliques avec des exemples. Mais du coup, on est perdu au début. Alors que si tu pars d'un problème concret, puis que tu introduis l'outil nécessaire à leur résolution (les arbres de décision), on suit progressivement un fil directeur.

Plus concrètement, tu pourrais faire un truc du genre :

- Accroche : on veut faire quelque chose pour laquelle les arbres de décision nous seront utiles (inscrire René au MIT par exemple).

- Présentation : on donne donc une idée intuitive de comment résoudre le problème, ce qui permet d'introduire les arbres de décision et de les placer dans un contexte.

- Précisions : on aimerait bien savoir ce qu'est exactement un arbre de décision maintenant.

En somme, avant de savoir ce que c'est, on veut savoir à quoi ça sert et avoir un exemple concret pas trop complexe.

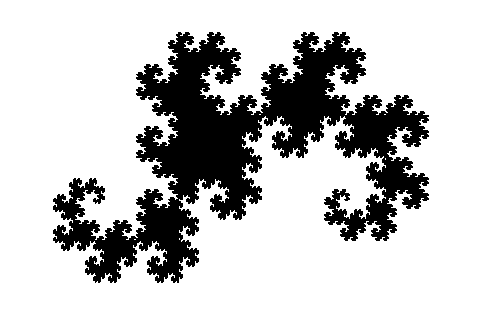

Par exemple, dans ce cours, avant d'aborder les graphes, on a des exemples. On s'amuse avec les sept ponts de Königsberg, puis on se rend compte que les graphes nous permettent de résoudre le problème : on a donc envie d'en apprendre plus. Bon ici, malheureusement, la suite devient très théorique : il aurait fallu, à mon avis, rappeler l'intérêt des graphes tout au long du chapitre en fournissant des exemples, des problèmes, des énigmes…

Bon courage !

)

)

,

,